Tutto_Scienze

#702

Inviato 11 febbraio 2016 - 16:01

Qualcuno ci fa un riassuntino su che roba è? O ce ne linka uno :**

Una tua action figure che quando la schiacci ti parla degli accordi.

#703

Inviato 11 febbraio 2016 - 16:05

Qualcuno ci fa un riassuntino su che roba è? O ce ne linka uno :**

meglio che lo dicano con parole loro perchè i riassuntini sono abbastanza incomprensibili

In realtà secondo me John Lurie non aveva tante cose da dire... ma molto belle

#704

Inviato 11 febbraio 2016 - 16:12

Qualcuno ci fa un riassuntino su che roba è? O ce ne linka uno :**

E quello che e' stato annunciato oggi:

In a highly anticipated announcement, physicists with the Advanced Laser Interferometer Gravitational-Wave Observatory (LIGO) revealed on 11 February that their twin detectors have heard the gravitational 'ringing' produced by the collision of two black holes about 400 megaparsecs (1.3 billion light-years) from Earth.

http://www.nature.co...at-last-1.19361

#705

Inviato 11 febbraio 2016 - 16:14

Qualcuno ci fa un riassuntino su che roba è? O ce ne linka uno :**

Le pietre miliari ahahaha

#707

Inviato 11 febbraio 2016 - 17:43

Scusate ma se l'evento era the collision of two black holes about 400 megaparsecs (1.3 billion light-years) from Earth, buchi neri che, riportando quanto scritto nell'articolo, si muovevano a velocità subluce, come faceva l'evento stesso ad essere highly anticipated?

Sono riusciti a prevedere la collisione?

#708

Inviato 11 febbraio 2016 - 17:45

Scusate ma se l'evento era the collision of two black holes about 400 megaparsecs (1.3 billion light-years) from Earth, buchi neri che, riportando quanto scritto nell'articolo, si muovevano a velocità subluce, come faceva l'evento stesso ad essere highly anticipated?

Sono riusciti a prevedere la collisione?

Premetto che non conosco i dettagli.

Sai, magari chiamano "collisione" un evento che dura qualche anno...

Riguardo la scoperta, rovescerei la prospettiva.

Non hanno scoperto le onde gravitazionali, che era ovvio esistessero, dal momento che sono previste dalle stesse equazioni che permettono al GPS di funzionare (un miliardo di dispositivi?) bensì hanno FINALMENTE trovato una seria conferma sperimentale dei buchi neri!

#709

Inviato 11 febbraio 2016 - 17:46

Quindi è stato solo il collasso ad avere avuto una velocità subluce?

#710

Inviato 11 febbraio 2016 - 17:51

Quindi è stato solo il collasso ad avere avuto una velocità subluce?

Qualunque evento che abbia a che fare con la materia deve avvenire a velocità inferiori a quelle della luce.

Le onde gravitazionali si propagano a velocità luce.

Il che vorrebbe automaticamente dire anche che il gravitone sia privo di massa.

Ma non vorrei dire cacchiate, l'esame di gravitazione e cosmologia non l'ho messo nel piano di studi perché volevo finire in tempo ![]()

E pensare che (come tutti) mi sono iscritto a fisica proprio perché ero curioso di imparare quelle cose lì ![]()

Ricordo quell'enorme libro con una mela e l'equazione di curvatura in copertina. Non l'ho mai letto ![]()

#711

Inviato 11 febbraio 2016 - 18:31

E sei finito a gestire i soldi di quattro evasori fiscali, com'è infida la vita.

voter negativity

Gozer il Gozeriano 119

reallytongues 112

#712

Inviato 11 febbraio 2016 - 19:27

Macchè, tutta brava gente.

Anzi proprio chi vuole evadere, l'ultima cosa che pensa è ad una banca italiana.

#713

Inviato 11 febbraio 2016 - 20:46

non è che "highly anticipated announcement" si riferisce alle voci fuoriscite prima dell'annuncio uffiiciale ?

#716

Inviato 11 febbraio 2016 - 22:41

#717

Inviato 11 febbraio 2016 - 23:45

Un "colore" che è iniziato (ed è potenzialmente misurabile) circa 380.000 anni prima del primo colore vero, le potenzialità di questa scoperta per la cosmologia sono pazzesche

#718

Inviato 12 febbraio 2016 - 00:25

Chi cerca trova, chi ricerca ritrova:

http://adsabs.harvar...PhRvL..22.1320W

Link al pdf (1969):

http://journals.aps....RevLett.22.1320

#719

Inviato 12 febbraio 2016 - 00:35

Chi cerca trova, chi ricerca ritrova:

http://adsabs.harvar...PhRvL..22.1320W

Link al pdf (1969):

http://journals.aps....RevLett.22.1320

http://physics.aps.org/story/v16/st19

Two papers in PRL, in 1969 and 1970, reported the first detections of such gravitational waves, coming apparently from the center of our galaxy. The discovery was later discredited, and the researcher behind it became a controversial figure.

#720

Inviato 12 febbraio 2016 - 00:36

GOMBLODDO

#721

Inviato 12 febbraio 2016 - 08:28

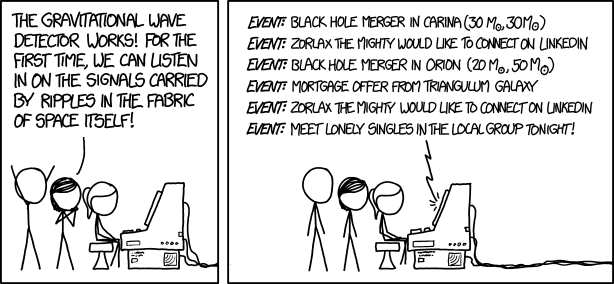

E se altre civiltà comunicassero con noi attraverso onde gravitazionali e fino ad ora non fossimo in grado di captarle?

#722

Inviato 12 febbraio 2016 - 12:29

questo articolo mi pare un compromesso decente, credo di aver compreso appieno un buon 30%

perchè il LIGO statunitense le ha captate e il VIRGO pisano no? siamo sempre i più stronzi

ma soprattutto

#723

Inviato 12 febbraio 2016 - 12:58

Ma ci sei mai stato a Pisa?

Quelli mentre passava l'onda gravitazionale stavano a guardà ir go dell'inte e a magnà ir lampredotto e a parlare del budello di su ma vestito da pirata.

E la grande onda se la sono persa:

A parte gli scherzi, se è vero quello che riporti mi sorprende. Per loro il VIRGO era il fiore all'occhiello e stavano sempre a parlare di quello...

Poi se non ho capito male la misura avviene in coppia fra i due laboratori, non in concorrenza: avrà fatto la conferenza stampa il leader fra i due.

Attendiamo che il Vernacoliere ci illumini sulla vicenda il prossimo mese. Del Tirreno non mi fido ![]()

#724

Inviato 12 febbraio 2016 - 14:00

la collaborazione tra LIGO e VIRGO sull'annuncio di ieri c'e' stata e continuera' ad esserci in futuro

#725

Inviato 12 febbraio 2016 - 14:28

la collaborazione tra LIGO e VIRGO sull'annuncio di ieri c'e' stata e continuera' ad esserci in futuro

è scritto chiaramente anche nel link che ho postato, domandavo per capire se la rilevazione da parte di un interferometro piuttosto che dell'altro potesse essere dovuta a qualche fattore tecnico che ignoro (potenza/puntatura/ecc.), dato per condiviso il fatto che la scoperta sia stata chiaramente targata dalla stampa come americana

#726

Inviato 12 febbraio 2016 - 14:30

Pisa

lampredotto

Se passa di qua un fiorentino mi sa che ti si mangia.

In effetti attendo anch'io la spiegazione del Vernacoliere, non delude mai

Ha già fatto tutto Black Mirror

#727

Inviato 12 febbraio 2016 - 14:32

Sulla stampa americana una volta ho pure letto che lo scienziato americano di origine italiana (!) Enrico Fermi ...

#728

Inviato 12 febbraio 2016 - 14:33

Pisa

lampredotto

Se passa di qua un fiorentino mi sa che ti si mangia.

In effetti attendo anch'io la spiegazione del Vernacoliere, non delude mai

sulle onde hanno già scritto qualcosa, o forse solo Il Troio ma vabbeh cmq è una manifestazione di pensiero del Vern

edit-> ecco:

#729

Inviato 12 febbraio 2016 - 14:59

Virgo è attualmente fermo per aumentare la sensibilità degli strumenti che lo compongono, dovrebbe ritornare ad essere operativo per la fine 2016 con parte della nuova strumentazione per arrivare ad essere pienamente operativo nel 2018.

Piuttosto a fine anno scorso è iniziato il fighissimo progetto LISA Laser Interferometer Space Antenna, che prevede alla fine del progetto (2034) tre interferometri a distanza di 5 milioni di km uno dall'altro disposti a triangolo equilatero che monitorando la distanza relativa permetteranno di verificare gli scostamenti dovuti alle onde gravitazionali

#730

Inviato 10 marzo 2016 - 13:11

Non mi ricordo se esiste il topic "tecnologie" e le ricerche non mi danno risultati quindi scrivo qui.

Qualcuno sta seguendo i recenti successi di Google DeepMind AlphaGo? Qualche tempo fa aveva battuto un campione europeo (2-dan mi sembra), ma il vero test sarebbe stato in questi giorni, quando si sarebbe cimentato in 5 partite contro uno dei piu' grandi campioni mondiali (9-dan), Lee Sedol.

Dalla iniziale previsione dello stesso Lee Sedol che avrebbe vinto 5-0 o al massimo 4-1, siamo passati alle prime 2 vittorie su 2 di AlphaGo. Ora Lee Sedol addirittura spera di riuscire a vincere almeno una partita.

Sto leggendo di esperti di Go dire che AlphaGo fa certe mosse che vanno oltre l'umana comprensione. Mosse che non erano mai state pensate prima d'ora, che parevano evidenti errori per poi risultare cruciali nella vittoria finale.

Livelli di intelligenza artificiale che in teoria non saremmo dovuti essere in grado di raggiungere se non fra piu' di 10 anni.

Mi sta eccitando tantissimo questa cosa.

links per chi fosse interessato:

- sulla inaspettata vittoria n.2 di oggi

- perche' tutto cio' e' importante

#731

Inviato 10 marzo 2016 - 15:36

Per attirare la vostra attenzione forse dovrei rinominarlo in Cosa ne sarà di noi quando la tecnologia sarà totalizzante?

Era stato nominato nel topic degli scacchi, anche se non afferro del tutto la vostra eccitazione per l'evento, per quotare un intervento di lft: Non so fino a quale punto si può sperare che esista qualcosa di utile per cui un essere umano sia necessariamente migliore di un robot

Forse è solo perché a Go! sono una pippa

Ha già fatto tutto Black Mirror

#732

Inviato 10 marzo 2016 - 15:57

Per attirare la vostra attenzione forse dovrei rinominarlo in Cosa ne sarà di noi quando la tecnologia sarà totalizzante?

Era stato nominato nel topic degli scacchi, anche se non afferro del tutto la vostra eccitazione per l'evento, per quotare un intervento di lft: Non so fino a quale punto si può sperare che esista qualcosa di utile per cui un essere umano sia necessariamente migliore di un robot

Forse è solo perché a Go! sono una pippa

io invece non afferro del tutto la tua mancanza di eccitazione. Ma tant'e', ognuno si eccita per motivi diversi.

E comunque non lo vedo necessariamente in ottica di Skynet & la vendetta delle macchine, ma semplicemente un avanzamento tecnologico sull'AI impressionante.

#733

Inviato 10 marzo 2016 - 16:56

#734

Inviato 10 marzo 2016 - 19:19

In ogni caso, deep learning non è nient'altro che le classiche reti neurali riaggiornate con una valanga di trucchetti e trucchettini - funzionano davvero bene, in certe (molte) applicazioni battono approcci ad hoc (tipo in computer vision mi sa che hanno spazzato via metà della ricerca che si faceva, idem in speech), ma non entusiasmano neanche me.

Codeste ambiguità, ridondanze e deficienze ricordano quelle che il dottor Franz Kuhn attribuisce a un'enciclopedia cinese che s'intitola Emporio celeste di conoscimenti benevoli. Nelle sue remote pagine è scritto che gli animali si dividono in (a) appartenenti all'Imperatore, (b) imbalsamati, c) ammaestrati, (d) lattonzoli, (e) sirene, (f) favolosi, (g) cani randagi, (h) inclusi in questa classificazione, (i) che s'agitano come pazzi, (j) innumerevoli, (k) disegnati con un pennello finissimo di pelo di cammello, (l) eccetera, (m) che hanno rotto il vaso, (n) che da lontano sembrano mosche.

non si dice, non si scrive solamente si favoleggia

#735

Inviato 10 marzo 2016 - 19:50

Magari dico la cazzata, ma anche a me non fa impazzire, per quanto i suoi risultati siano affascinanti.

Alla fine si tratta di reti neurali, all'interno si possono gestire i vari layer, memorie, parametrizzare, etc., ma alla fine dei conti sono pur sempre basate sul calcolo stocastico (-> probabilistico -> casuale, l'ho detta), no?

Neuro/marguati/boh, sconvolgetemi spiegandomi bene una volta per tutte le reti neurali.

#736

Inviato 10 marzo 2016 - 19:58

*del tipo: voglio riconoscere il numero "8"? Contiamo il numero di "anelli". E se un anello (scritto a mano) non si chiude? Proviamo prima a passare sopra l'immagine un po' di rumore gaussiano, poi ricampioniamo, shiftiamo un po', e vattelapesca..

Codeste ambiguità, ridondanze e deficienze ricordano quelle che il dottor Franz Kuhn attribuisce a un'enciclopedia cinese che s'intitola Emporio celeste di conoscimenti benevoli. Nelle sue remote pagine è scritto che gli animali si dividono in (a) appartenenti all'Imperatore, (b) imbalsamati, c) ammaestrati, (d) lattonzoli, (e) sirene, (f) favolosi, (g) cani randagi, (h) inclusi in questa classificazione, (i) che s'agitano come pazzi, (j) innumerevoli, (k) disegnati con un pennello finissimo di pelo di cammello, (l) eccetera, (m) che hanno rotto il vaso, (n) che da lontano sembrano mosche.

non si dice, non si scrive solamente si favoleggia

#737

Inviato 10 marzo 2016 - 20:59

Circa vent'anni fa, quando Deep Blue vinse contro Kasparov, ricordo che lessi un articolo su Focus in cui si parlava di GO come il gioco in cui "nessun computer potrà mai vincere".

Il fatto che il numero possibile di partite giocabili sia infinitamente superiore al numero di atomi nell'universo ha decisamente barzottato anche me quando ho letto la notizia dell'1-0 per AlphaGo.

Ovviamente 20 anni fa da ragazzino pensai che fosse naturale scrivere una frase come quella che cito a memoria, ma crescendo ci ho spesso ripensato quando mi son ricordato di quella sfida a scacchi e ho sempre detto "chissà quando vincerà la macchina"; perché sapevo che quella frase era sbagliata, frutto della tipica sindrome tutta sapiens del punto terminale. Secondo tale teoria inconsciamente applicata da miliardi di persone per miliardi di invenzioni e limiti scientifici, noi siamo il punto terminale dell'evoluzione tecnologica, mentre la realtà ci ha dimostrato e ci dimostra ogni giorno che saremo sempre in uno degli infiniti punti intermedi del segmento che porta dall'origine all'estinzione dell'uomo. I nostri antenati hanno definito impossibile ciò che oggi usiamo quotidianamente senza provare alcun brivido.

#738

Inviato 10 marzo 2016 - 23:52

Il fatto che il numero possibile di partite giocabili sia infinitamente superiore al numero di atomi nell'universo ha decisamente barzottato anche me quando ho letto la notizia dell'1-0 per AlphaGo

Questa è un po' una puttanata, nel senso che quando si parla di cose che crescono esponenzialmente è facile riempirsi la bocca con cose tipo "il numero di atomi dell'universo" ma che non dicono assolutamente nulla sulla reale difficoltà del problema.

Quando chiedi a Google di calcolarti il percorso da A a B, pensa che riescono addirittura a trovare il percorso più breve (ed è matematicamente garantito che lo sia) fra *tutti* i possibili percorsi da A a B - che guarda un po', ci metto la mano sul fuoco, sono più degli atomi dell'universo :-)

Codeste ambiguità, ridondanze e deficienze ricordano quelle che il dottor Franz Kuhn attribuisce a un'enciclopedia cinese che s'intitola Emporio celeste di conoscimenti benevoli. Nelle sue remote pagine è scritto che gli animali si dividono in (a) appartenenti all'Imperatore, (b) imbalsamati, c) ammaestrati, (d) lattonzoli, (e) sirene, (f) favolosi, (g) cani randagi, (h) inclusi in questa classificazione, (i) che s'agitano come pazzi, (j) innumerevoli, (k) disegnati con un pennello finissimo di pelo di cammello, (l) eccetera, (m) che hanno rotto il vaso, (n) che da lontano sembrano mosche.

non si dice, non si scrive solamente si favoleggia

#739

Inviato 11 marzo 2016 - 07:50

@deba: parlo sempre senza troppa cognizione di causa (quindi chiedo), ma ero rimasto che fondamentalmente le reti funzionavano prendendo parametri X in input e restituendo un Y che massimizza un risultato, e bon, ad esempio nel GO (come in qualsiasi altro gioco) è relativamente semplice codificare matematicamente lo stato del gioco e la possibilità di vincere, per cui si può andare di deep learning etc.

Insomma, avrei detto più trovare pattern (dove sono fortissime) che sintetizzare autonomamente concetti astratti (coi quali invece che io sappia hanno problemi).

Ma smentitemi tranquillamente, chiedo per essere illuminato.

#740

Inviato 11 marzo 2016 - 08:09

Niente di particolarmente nuovo, la grande innovazione è perlopiù l'aver capito negli ultimi tre-quattro anni come (più o meno) addestrare queste reti, prima semplicemente non ci si riusciva [non solo perché mancava la potenza di calcolo].

La codifica dello stato del gioco certo che è banale, è una griglia. Il punto è trovare una codifica *utile*, che è il problema (in gran parte) bypassato dalle reti profonde. Per dire, cosa è dello stato del gioco che mi fa capire se sono in vantaggio o no? (visto che con buona probabilità non ho mai visto quella configurazione prima..) Il numero di bottoni bianchi? Il numero di celle scoperte?

Codeste ambiguità, ridondanze e deficienze ricordano quelle che il dottor Franz Kuhn attribuisce a un'enciclopedia cinese che s'intitola Emporio celeste di conoscimenti benevoli. Nelle sue remote pagine è scritto che gli animali si dividono in (a) appartenenti all'Imperatore, (b) imbalsamati, c) ammaestrati, (d) lattonzoli, (e) sirene, (f) favolosi, (g) cani randagi, (h) inclusi in questa classificazione, (i) che s'agitano come pazzi, (j) innumerevoli, (k) disegnati con un pennello finissimo di pelo di cammello, (l) eccetera, (m) che hanno rotto il vaso, (n) che da lontano sembrano mosche.

non si dice, non si scrive solamente si favoleggia

#741

Inviato 11 marzo 2016 - 09:52

A proposito del Maurizio Costanzo show, a me l'ospitata del Joker al programma del personaggio di De Niro ha ricordato una di Aldo Busi, ma proprio uguale, compreso il balletto con cui si presenta al pubblico. Dubito che Phoenix si sia ispirato a quella, ma in certe parti, quando si mette a checcheggiare, la somiglianza era impressionante.

il primo maggiorenne che vedrò vestito da joker a carnevale, halloween o similia lo prendo per il culo di brutto

minimo un A STRONZOOOO, ANCORA STU JOKER? STRONZOOOO, vieni a casa mia che ho bisogno di una mano a sgomberare la mansarda, STRONZOOOO

There is a duality between thought and language reminiscent of that which I have described between dreaming and play

Man the sum of his climatic experiences Father said. Man the sum of what have you

#742

Inviato 11 marzo 2016 - 11:20

Il fatto che il numero possibile di partite giocabili sia infinitamente superiore al numero di atomi nell'universo ha decisamente barzottato anche me quando ho letto la notizia dell'1-0 per AlphaGo

Questa è un po' una puttanata, nel senso che quando si parla di cose che crescono esponenzialmente è facile riempirsi la bocca con cose tipo "il numero di atomi dell'universo" ma che non dicono assolutamente nulla sulla reale difficoltà del problema.

Quando chiedi a Google di calcolarti il percorso da A a B, pensa che riescono addirittura a trovare il percorso più breve (ed è matematicamente garantito che lo sia) fra *tutti* i possibili percorsi da A a B - che guarda un po', ci metto la mano sul fuoco, sono più degli atomi dell'universo :-)

Ci sta che sia parzialmente una puttanata, ma di fatto per 20 anni GO è stato un gioco "ingiocabile" per la macchina proprio perché l'approccio all'intelligenza artificiale era totalmente sballato. Siamo d'accordo che google ti dia le direzioni migliori, ma lì ha una serie di percorsi precodificati in modo semplice, perché stai comunque cercando di minimizzare la distanza fra A e B, mentre qui si tratta di vincere e per farlo non hai un punto B, ma miliardi di configurazioni B a cui puoi puntare (e se in apertura gioca la macchina hai anche tutti i punti A dei nodi della scacchiera).

Sui percorsi infiniti credo valga la pena omaggiare Borges:

Andarono tre giorni e gli disse: « Oh, re del tempo e sostanza e cifra del secolo! In Babilonia mi vorresti perdere in un labirinto di bronzo con molte scale, porte e muri; ora l’Onnipotente ha voluto ch’io ti mostrassi il mio dove non ci sono scale da salire, né porte da forzare, né corridoi da percorrere, né muri che ti vietano il passo».Poi gli sciolse i legami e lo abbandonò in mezzo al deserto, dove quegli morì di fame e di sete.

#743

Inviato 11 marzo 2016 - 14:07

Dando per scontato che si sappia come funziona l'algoritmo di una rete neurale e come funzioni l'algoritmo di back propagation per l'addestramento:

Innanzitutto c'è un risultato positivo, che è il teorema di Cybenko [1989] cui si riferiva Debaser: le reti neurali sono approssimatori universali, nel senso che data qualsiasi funzione, esiste una rete neurale (anche ad un solo layer) che approssima la funzione entro un errore piccolo a piacere.

Quello che NON fa il teorema di Cybenko però è:

1) porre un limite al numero di neuroni in termini dell'errore massimo desiderato;

2) porre un limite al numero di connessioni medie di questi neuroni;

3) porre un limite alla durata dell'addestramento della rete neurale.

Infatti c'è un risultato negativo anche antecedente, un teorema di Minsky (recentemente deceduto) e Papert dal loro libro 'Perceptrons': una rete neurale che calcola la parità di N input binari, in cui ogni neurone è connesso a K altri neutroni, deve contenere almeno ca. N/K neuroni (riformulazione mia). Ovvero è una rete un po' inutile.

In generale quindi, potrei benissimo anche io con conoscenze=0 insegnare a una rete neurale genericissima a giocare a Go usando backward propagation, ma il problema sarebbe:

- ci vorrebbero una quantità smodata di neuroni;

- questi neuroni sarebbero connessi in media a quasi tutti gli altri (= mi servirebbe una memoria inimmaginabile per salvarmi i pesi delle connessioni);

- ci vorrebbe più dell'età dell'universo per terminare l'addestramento.

Il Deep Learning è un modo di aggirare questi problemi che funziona bene per alcuni casi. L'idea di base è l'ansatz che una rete neurale generica, una volta addestrata per risolvere questi problemi, avrebbe una struttura pressoché gerarchica, organizzata in layer. Questa è in pratica una congettura sul problema che la rete vuole risolvere in sè.

Quindi, se ci si aspetta una organizzazione gerarchica, tanto vale organizzare direttamente la rete neurale in modo gerarchico e risparmiarsi la fatica di far emergere questa organizzazione in maniera spontanea.

Deep Learning quindi è un metodo che forza l'architettura ad essere gerarchica, e oltretutto (e questa è un'altra intuizione del metodo credo) forza i layer ad essere via via più piccoli.

Il modo in cui queste forzature sono realizzate è il seguente [qui parlo delle reti dette convolutive]: ogni layer è in realtà fatto di due layer; il primo fa delle medie(*) di ogni dato in ingresso con i dati in ingresso a lui vicini (e l'importanza della vicinanza è un'altra forte ipotesi del metodo); il secondo è una rete addestrata per simulare la funzione identità (f(x) = x), solo che i bit in ingresso sono di più di quelli in uscita, col risultato che questo secondo layer effettua sostanzialmente una compressione del suo input.

(*) Quando dico "medie" si pensa a (x+y)/2, che è una media con pesi 1/2 e 1/2 ovvero tutti positivi, ma in verità bisogna accettare anche medie con segni alterni: per esempio con pesi 1/2 e -1/2. Qual è la differenza? una media come la prima esalta il valore di zone uniformi (x=1, y=1, (x+y)/2 = 1) e annulla il valore delle zone di contrasto (x=1, y=-1, (x+y)/2 = 0); una media come la seconda fa il contrario, esalta i contrasti (x=1,y=-1, (x-y)/2=1) e annulla le zone uniformi (x=1,y=1, (x-y)/2=0). Una rete convolutiva farà più di un tipo di media, e poi combinerà le informazioni ottenute nei layer successivi.

Questi layer vengono quindi composti insieme un po' di volte, e quando il dato iniziale si è ridotto abbastanza di dimensione ci ritroviamo con una manciata di possibilità, che possiamo anche analizzare con una rete neurale standard con tutte le connessioni possibili (tanto ormai sono poche).

Combinando la struttura con la compressione quindi, il tempo richiesto per addestrare la rete si riduce ; inoltre è in genere possibile addestrarle un layer alla volta, il che abbassa la durata dell'addestramento di moltissimo, diventando fattibile.

Se è questo l'approccio che quelli di AlphaGo hanno usato, che il tutto si possa applicare al Go è in effetti non banale. Qual è il fatto? il fatto è che il Go è un gioco molto locale, in cui ci sono svariate zone "di combattimento" che interagiscono prima localmente e solo poi globalmente. Una pedina può esercitare influenza solo sui suoi vicini.

Una rete convolutiva addestrata per giocare a Go prima analizzerebbe una posizione di gioco in piccole zone della scacchiera, ottenendo una situazione su una 'scacchiera' idealizzata di dimensione più piccola in termini di piccoli pattern, e poi combinerebbe queste informazioni in una scacchiera ancora più piccola, e così via, finché non fosse giunta ad una catalogazione dei pattern globali in termini della qualità della posizione: ottima, buona, neutra, cattiva, pessima. Le mosse da decidersi sarebbero quindi tra quelle che spostano l'asticella della qualità verso l'alto, e forse è addirittura possibile che si possano predire percorrendo la rete al contrario, un po' come Deep Dream fa con le immagini.

Notare che questo fa anche sospettare che un approccio simile non possa funzionare per gli scacchi, perché gli scacchi non sono locali: metà dei pezzi sono globali, perché possono muoversi e tenere sotto tiro pezzi anche all'altro lato della scacchiera.

Il tutto tenendo conto che sono un ignorante sia delle reti neurali, che del Go e degli scacchi professionali, quindi posso aver detto un mucchio di stronzate

#744

Inviato 11 marzo 2016 - 14:12

il neofita non dovrebbe leggere marguati

Ha già fatto tutto Black Mirror

#745

Inviato 11 marzo 2016 - 14:19

Codeste ambiguità, ridondanze e deficienze ricordano quelle che il dottor Franz Kuhn attribuisce a un'enciclopedia cinese che s'intitola Emporio celeste di conoscimenti benevoli. Nelle sue remote pagine è scritto che gli animali si dividono in (a) appartenenti all'Imperatore, (b) imbalsamati, c) ammaestrati, (d) lattonzoli, (e) sirene, (f) favolosi, (g) cani randagi, (h) inclusi in questa classificazione, (i) che s'agitano come pazzi, (j) innumerevoli, (k) disegnati con un pennello finissimo di pelo di cammello, (l) eccetera, (m) che hanno rotto il vaso, (n) che da lontano sembrano mosche.

non si dice, non si scrive solamente si favoleggia

#747

Inviato 11 marzo 2016 - 20:03

Il punto mi sembra solo avere un modo di valutare/comparare la bontà di una posizione in un gioco con tantissime posizioni e senza gerarchia tra i pezzi (unlike scacchi), il resto è la solita roba che il computer può giocare più mosse avanti rispetto all'umano, stessa roba degli scacchi.

Come negli scacchi pare che il computer giochi mosse che a un umano "addestrato" classicamente non verrebbero mai in mente, ovvero non si muove per euristiche umane.

voter negativity

Gozer il Gozeriano 119

reallytongues 112

#748

Inviato 12 marzo 2016 - 15:23

Il punto mi sembra solo avere un modo di valutare/comparare la bontà di una posizione in un gioco con tantissime posizioni e senza gerarchia tra i pezzi (unlike scacchi), il resto è la solita roba che il computer può giocare più mosse avanti rispetto all'umano, stessa roba degli scacchi.

Come negli scacchi pare che il computer giochi mosse che a un umano "addestrato" classicamente non verrebbero mai in mente, ovvero non si muove per euristiche umane.

Direi proprio di si, non sono un esperto di Go ma se ho capito bene il problema stava nella valutazione - e comprensione esatta - della posizione piuttosto difficoltosa dato il numero esagerato di posizioni.

Negli scacchi però è un pò diverso perchè si riescono a fare molte più considerazioni. Ad esempio un cavallo in angolo viene assegnato un valore più basso - per la valutazione della posizione - rispetto a quello nominale (3) e così via per situazioni specifiche. Si tratta insomma di pesare correttamente le posizioni infatti anche cambiamenti minimali possono mutare radicalmente l'output. Diciamo che è un compendio tra conoscenza umana del gioco, set enorme di partite e profondità di calcolo.

Quelli di AlphaGo in realtà mi pare usino il deep learning "solo" per cacare fuori un insieme (piccolo) di mosse promettenti, poi fanno un po' di altre cose per valutare la migliore (una ricerca in avanti vecchio stile, mi pare di capire, e con una profondità limitata visto il branching factor enorme).

E' qui che sarebbe da capire se hanno fatto qualcosa di nuovo.

#749

Inviato 12 marzo 2016 - 15:55

Codeste ambiguità, ridondanze e deficienze ricordano quelle che il dottor Franz Kuhn attribuisce a un'enciclopedia cinese che s'intitola Emporio celeste di conoscimenti benevoli. Nelle sue remote pagine è scritto che gli animali si dividono in (a) appartenenti all'Imperatore, (b) imbalsamati, c) ammaestrati, (d) lattonzoli, (e) sirene, (f) favolosi, (g) cani randagi, (h) inclusi in questa classificazione, (i) che s'agitano come pazzi, (j) innumerevoli, (k) disegnati con un pennello finissimo di pelo di cammello, (l) eccetera, (m) che hanno rotto il vaso, (n) che da lontano sembrano mosche.

non si dice, non si scrive solamente si favoleggia

#750

Inviato 12 marzo 2016 - 16:24

Nes e Yo. Più precisamente è una cosa tipo (almeno negli scacchi, a go non gioco) che il computer calcola con esattezza più mosse e varianti nel breve periodo rispetto ad un uomo - generalmente dalle 20 alle 25 mosse per ciascuna variante. L'uomo, che gioca secondo "teoria", nel calcolo è schiacciato, ma pensa in termini di vantaggio a lungo termine (50, 60 mosse, che però non calcola con matematica precisione). È per questo che nel gioco per corrispondenza i computer sono ammessi: a loro fai fare la tattica e tu ti fai la strategia.il resto è la solita roba che il computer può giocare più mosse avanti rispetto all'umano, stessa roba degli scacchi.

Il paper non l'ho letto però volevo dare un minimo contributo "sportivo".

E un passo di quella danza era costituito dal tocco più leggero che si potesse immaginare sull'interruttore, quel tanto che bastava a cambiare...

... adesso

e la sua voce il grido di un uccello

sconosciuto,

3Jane che rispondeva con una canzone, tre

note, alte e pure.

Un vero nome.

0 utente(i) stanno leggendo questa discussione

0 utenti, 0 ospiti, 0 utenti anonimi